2025年4月,研究团队涂耿、王冰冰、宋新彤同学的三篇论文获SIGIR 2025录用。在中国计算机学会推荐会议列表中被列为A类会议。会议将于2025年7月13日-7月18日在意大利帕多瓦召开。

题目:Meta-Learning for Incomplete Multimodal Sentiment Analysis

作者:涂耿,吴天昊,罗璇,曾曦,李文捷,徐睿峰*

简介:模态缺失是多模态情感分析(MSA)中的一个关键但尚未充分研究的挑战。现有方法通常在固定的缺失率下训练和评估,难以应对现实中缺失率变化的情况。为此,论文提出了缺失模态自适应框架(M2AF),通过模型无关的元学习方法提升模型在不同模态缺失程度下的鲁棒性。M2AF包含两个阶段:元训练阶段中,将已在固定缺失率下训练好的MSA模型进一步适应低、中、高不同程度的缺失率;元测试阶段中,模型通过少量数据快速更新参数,以适应具体的缺失场景。在两个主流数据集上的实验表明,M2AF显著提升了多种MSA模型在不同模态缺失条件下的性能和泛化能力。

M2AF伪代码描述

题目:More Than Just a Conversation: A Multi-agent Reasoning Graph Knowledge Distillation for Conversational Stance Detection

作者:王冰冰,白梽新,王乾龙,林靖杰,杨敏,曾曦,徐睿峰*

简介:对话立场检测任务旨在识别社交媒体中用户评论的立场。在实际情境下,随着对话轮次不断增多,对话内容愈发复杂,仅依靠简单引入对话上下文的现有方法,已难以有效捕捉到实现精确立场检测所必需的细粒度信息。为了解决这一问题,本文提出了一种多智能体推理图知识蒸馏框架(MRGKD),将多个大语言模型的对话推理能力蒸馏至较小的语言模型中。具体而言,本文首先构建了一个多智能体推理图,从多个LLM的不同视角推理对话历史中隐含的逻辑关系。为充分利用LLMs的上下文学习能力,MRGKD框架中设计了一种推理知识编辑机制,使得小模型在输出分布上对齐于对话历史以及推理图中提取的知识,从而内化新信息。此外,MRGKD框架引入了对比损失函数,以区分正确与错误的推理结果,同时结合立场检测损失,共同作用于语言模型的微调过程。该方法不仅确保了逻辑知识的准确获取,也保持了对话历史信息的完整性。在公共对话立场检测数据集上的实验结果表明,本文提出的MRGKD框架显著提升了小模型的性能,全面优于现有的各类基线模型。

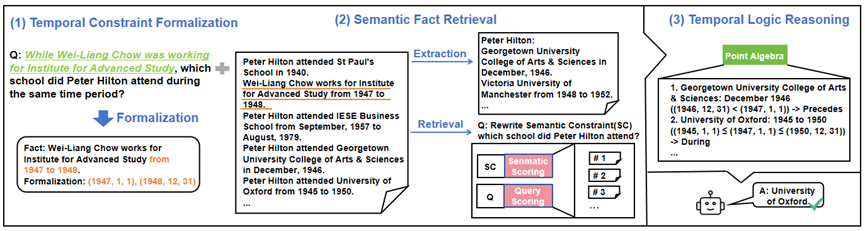

标题:Bridging Time Gaps: Temporal Logic Relations for Enhancing Temporal Reasoning in Large Language Models

作者:宋新彤,梁斌,孙洋,张宸华,王冰冰,徐睿峰*

对时间的理解和认知是人类理解世界的基础。尽管大语言模型在多项推理任务中已经展现出强大的推理能力,但它们在时序推理方面仍存在明显不足,这主要是由于时间表达式的多样性以及其缺乏时序逻辑推理能力。为此,本文提出了一种时序思维链框架(TempCoT),通过三阶段推理策略来提升大语言模型在时序推理任务上的表现。首先,TempCoT 会显式抽取问题中的时间约束,以确保在推理过程中建立准确的时间参照。其次,引入语义检索机制来动态获取关键的时间事实,从而增强推理过程中信息的完整性和可靠性。最后,基于点代数思想构建了显式时序逻辑推理模块,提高了时序推理的一致性和可解释性。实验结果表明,TempCoT 显著提升了五种不同大语言模型的时序推理性能,并且在复杂的时序推理任务上表现出更强的鲁棒性。

整体架构