2月24日,ACL 2022录用结果公布。研究组共有五篇论文被ACL 2022主会录取。国际计算语言学年会(Annual Meeting of the Association for Computational Linguistics,简称ACL)是计算语言学和自然语言处理领域的国际排名第一的顶级学术会议,每年召开一次。在中国计算机学会推荐会议列表中被列为A类会议。2022年是第60届会议,将于5月22日至5月27日在爱尔兰都柏林以线上线下混合形式举行。

以下为论文列表及介绍:

题目:JointCL: A Joint Contrastive Learning Framework for Zero-Shot Stance Detection

作者:梁斌,祝清麟,李想,杨敏,桂林,何瑜岚,徐睿峰

简介:本文提出了一种联合对比学习框架,用在零样本立场检测任务中。我们发现,在对从未见过的目标(target)预测立场时,通常存在两种情况:1)可以直接根据测试样本的上下文信息判断该目标的立场类别;2)当我们无法直接从测试样本的上下文判断该目标的立场类别时,通常将其与已学习的目标相关联,找出跟这个从未见过的目标有联系的已知目标,从而实现立场推断。基于此,本文提出了一种分层对比学习框架,从两个层面来解决零样本立场检测问题。1)在第一层,使用立场类别作为监督信号,提出一种面向立场信息的对比学习方法;2)在第二层,提出了一种原型图网络对比学习。通过构建原形图(prototypical graph),可以有效地在未知目标和已知目标之间建立关系,从而用已学习到的信息表示未知目标,从而提升对未知目标的立场学习能力。在三个公开数据集上的实验结果表明,本文提出的联合对比学习框架在零样本立场检测中取得最佳性能。同时,该框架也能直接迁移至少样本立场检测和跨目标立场检测任务中,并取得最佳性能。

题目:Have my arguments been replied to?Argument Pair Extraction as Machine Reading Comprehension

作者:鲍建竹,孙婧伊,祝清麟,徐睿峰

简介:论点对提取(APE)任务的目的是从两个相互关联的论辩性文档中自动抽取论点对。现有的研究通常通过预测两个文档之间的句子级关系来间接识别论点对,但忽略了对整体论点级互动的建模。针对这一问题,本文通过机器阅读理解(MRC)框架分两个阶段实现论点对提取。第一阶段采用论点挖掘查询(AM query)识别两个文件中的所有论点。第二阶段将每个被识别的论点视为一个论点对抽取查询(APE query),从另一个文档中提取与其配对的论点,从而更好地捕捉论点层面的互动。同时,这一框架使上述两个阶段能够在单一的MRC模型中联合训练,从而使它们的相互增益最大化。实验结果表明,本文的方法取得了当前最好的性能。

题目:Multi-Modal Sarcasm Detection via Cross-Modal Graph Convolutional Network

作者:梁斌,娄辰玮,李想,杨敏,桂林,何瑜岚,裴文杰,徐睿峰

简介:本文提出了一种有效的基于跨模态图的多模态讽刺识别模型。我们发现,在多模态讽刺识别任务中,对于图片模态,直接学习整个图片的信息很困难,且图片中存在很多与讽刺识别无关的视觉信息。为此,首先使用目标检测(object detection)来识别图片中的重要视觉块以及视觉块的对应描述。随后,将视觉块的描述作为一座桥梁,将离散的视觉块和文本连接起来,构造跨模态关系图。同时,通过引入外部情感知识,进一步挖掘不同模态间的情感不一致性,从而有效识别多模态数据中的讽刺信息。在公开数据集的实验结果表明,本文提出的模型取得了最佳性能。

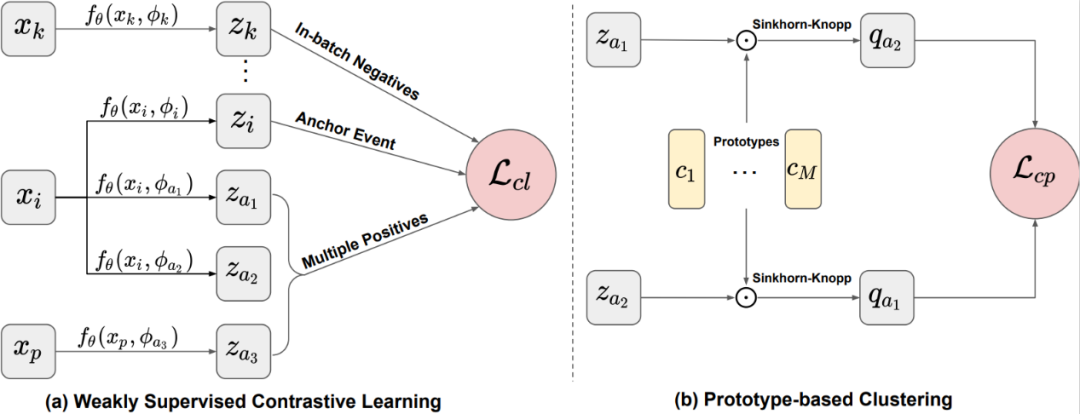

题目:Improving Event Representation via Simultaneous Weakly Supervised Contrastive Learning and Clustering

作者:高俊,王伟,禹常隆,赵欢,Wilfred Ng,徐睿峰

简介:事件是文本中的一种重要信息,学习一个好的事件表示对于很多任务都非常重要。过去的事件表示学习方法通常依赖于一些成本较高的人工标注数据,如篇章关系以及常识知识等。本文结合弱监督对比学习以及聚类,提出了一种轻量级事件表示学习框架SWCC。SWCC不依赖于人工标注的数据,而是采用事件在文档中的共现频率作为弱监督信号来学习事件表示。同时,为了让事件表示在学习过程中能够感知全局信息,我们引入了一种基于Prototype的在线聚类方法。在训练过程中,模型在进行对比学习的同时进行聚类。实验表明本文提出的SWCC模型在事件表示的三个任务上都取得了SOTA结果。同时,在下游任务中也具备较大的优势。

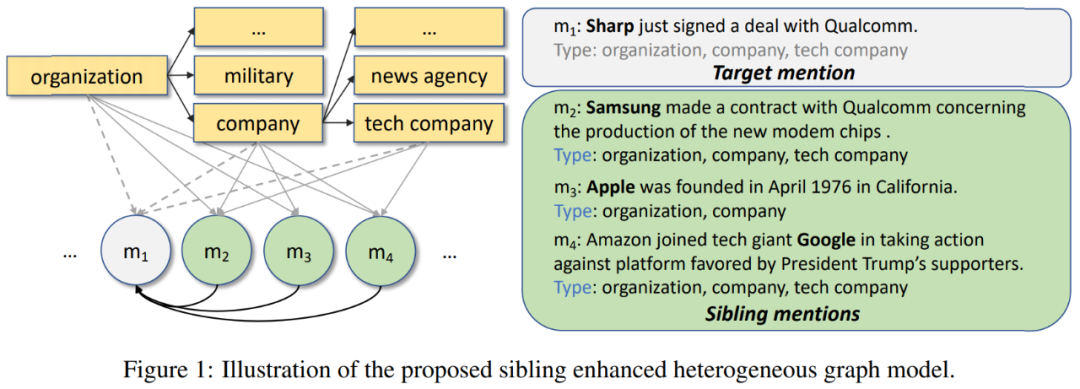

题目:Learning from Sibling Mentions with Scalable Graph Inference in Fine-Grained Entity Typing

作者:陈奕,程嘉扬,蒋海云,刘乐茂,张海松,史树明,徐睿峰

简介:在细粒度实体分类(Fine-grained Entity Typing,FGET)任务中,学习处于特定上下文的实体提及(Entity Mention)的有效特征表示是一个富有挑战性的问题。本文首先通过定量分析发现,现有实体分类技术在上下文信息不足的情况下,对实体提及识别表现欠佳,使得模型的整体性能受限。为此,本文首次探索了利用兄弟提及(Sibling Mention)信息结合图神经网络来增强目标实体提及的表示学习。实验结果表明,本文的方法能够有效提升模型在FGET任务上的性能。